由于篇幅限制,本文为第三十一封来信的后半部分。阅读文章第一小节「媒体中的两种性别偏见:女性如何被代表和表现?」,请点击下方链接:

2、爱男厌女的AI:他是面无表情的医生,她是笑脸盈盈的护士

为了解答这两个研究问题,我们根据美国人口普查数据选择了153个常见职业,并用OpenAI旗下的产品DALL·E 2为每个职业生成了100张图片,由此得到了15300张AI生成的图片。然后,我们又从谷歌图像(Google Image)收集了153×100=15300张同样职业的图片作为参照。之后我们用计算机方法识别图片中占据面积最大的人物的特征(包括性别、是否微笑,以及面部的角度),为后续数据分析作准备。

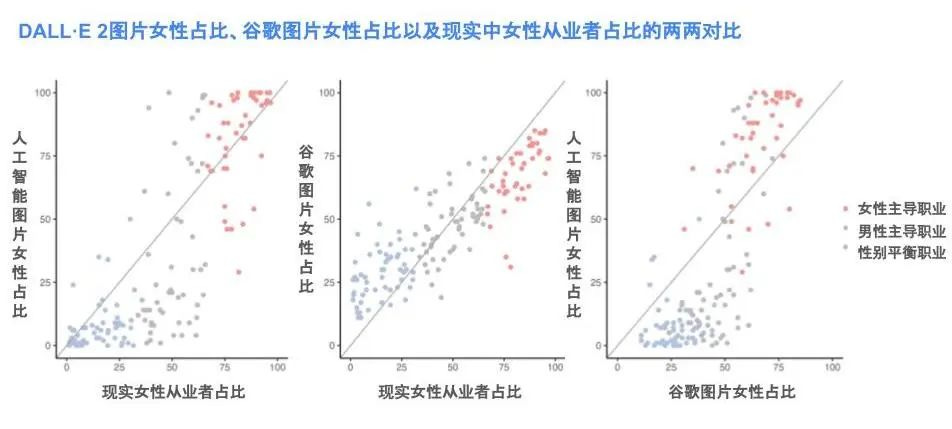

在分析代表型歧视时,我们对比了DALL·E 2生成图片中的人脸、谷歌图片中的人脸,以及现实中这153种职业从业者的性别比,结果显示:在所有谷歌图片中,46.4% (7,105) 的人物是女性,53.6% (8,195) 是男性。而在AI生成的图片中,只有38.4% (5,878) 的人脸是女性,而男性占比则高达61.6% (9,422)。

此外,根据2021年美国人口职业普查,我们把153种职业分成了三类:女性主导职业(女性从业者比例高于66.7%)、性别平衡职业、男性主导职业(女性比例低于33.3%),并分别用红色 、灰色和蓝色代表。如图所示,和现实相比,在大部分男性主导(如程序员)和性别平衡的职业(如律师)中,DALL·E 2生成的女性图片数量明显不足。而在女性主导的职业(如护士)中,女性的占比又过高了——我们把这一现象称作“偏见放大”(Bias amplification)效应。令人惊讶的是,相比之下,谷歌图片的性别差距要比现实小,这有助于打破人们对性别和职业的刻板印象。

为了进一步分析AI绘图中的表现型性别偏见,我们对比了DALL·E 2图片和谷歌图片中不同性别的微笑情况和面部仰角。结果显示,和男性相比,DALL·E 2图片中的女性更有可能微笑,且这种性别差异比谷歌图片更明显。而且,相比其它两类职业,女性主导职业(如护士)的图片中「女性更容易微笑」这一问题要更加严重——可见AI放大了与职业相关的表现型偏见,且它的偏见放大效应比谷歌图像更强。此外,在DALL·E 2生成的女性主导职业的图片中,女性比男性更容易低头,也就是说和男护士相比,女护士更可能低头。

3、解决问题的钥匙:融入女性主义视角,摒弃男本位科学

借助这项研究,我们已经确定了问题所在,那么这些问题又该如何解决呢?

我们认为,要消除AI中的性别偏见,科技公司首先应该提升技术的透明度。在去年发布的GPT-4技术报告中,OpenAI声称DALL·E 2生成的图片存在歧视现象是因为取自互联网的训练数据本身就有问题。为了检验这种说法,我们对比了DALL·E 2生成的图片和谷歌图像中的性别偏见,其中后者作为最常用的在线图像搜索引擎能代表来自互联网的训练数据。然而,统计结果显示DALL·E 2中的性别偏见其实比谷歌图像严重得多。也就是说,OpenAI报告中的说法不太能站得住脚,其将自家产品中的偏见归因于训练数据这一做法大有推卸责任的嫌疑。

由此可知,我们有必要针对图片生成型AI产品本身的问题进行研究,从而提出针对性的解决方案。然而,由于种种原因,这类产品目前就像一个密闭的“黑匣子”——我们对它内部的情况几乎一无所知,所以也很难消除其中的性别偏见。因此,我们呼吁人工智能行业和学术界达成合作协议,以安全且合乎伦理的方式共享数据、审计模型表现、消除算法中的偏见。只有提高人工智能产品的透明度,公众、人工智能从业者以及不同领域的研究人员才有机会参与集体决策。此外,这种做法亦有助于防止少数巨头垄断人工智能技术、将科技进步用于一己私利。

除了提升透明度,人工智能行业的开发人员也应该承担责任,将「女性主义认识论」融入到日常工作之中。目前科学界盛行的理性主义范式把男性当作标准(male as norm),导致女性主义知识生产的重要性被严重低估。于是,人工智能的历史叙事被男性和理性主义主导,女性视角在AI发展的历史中被极度边缘化。在这种情况下,我们必须以女性主义认识论为基础,重新书写科技发展的历史,重构人们对于人工智能的理解。长此以往,男本位科学界习惯性忽视女性利益的现状或许就能够得到改善。

在分析了覆盖153个职业的15,300张图片之后,我们发现两种性别偏见(代表型和表现型偏见)在DALL·E 2生成的图片中广泛存在。更糟糕的是,通过对比现实中的美国人口职业普查数据和谷歌图像,我们发现AI甚至放大了本就存在的性别偏见。在男性主导的职业里,DALL·E 2生成的图片女性代表性不足,而女性主导的领域中女性的代表性又过高。在表现型歧视方面,微笑的女性明显多于男性,且这一问题在女性主导的职业中甚至更加严重。大概没有任何一个女权主义者会否认“被看见是很重要的”,而我们想说,“以怎样的方式被看见也是很重要的”。因此,提高人工智能技术的透明度,在女性主义认识论的指导下系统性地审查并消除其中的性别偏见可谓刻不容缓。

就此搁笔,期待下一次和大家见面!

陌生女人1号*

二〇二四年三月五日

*本文由陌生女人1号主笔,陌生女人2号编辑。其中介绍的论文题目为“Smiling Women Pitching Down: Auditing Representational and Presentational Gender Biases in Image Generative AI”(低头微笑的女性:审计「图片生成型人工智能」中的代表型和表现型性别偏见)。